Luciana Parisi

Si tratta della traduzione, inedita in italiano. del pezzo: «Instrumental Reason, Algorithmic Capitalism, and the Incomputable» in, a cura di Matteo Pasquinelli Augmented Intelligence Trauma. Alleys of Your Mind, Meson Press, Lüneburg, 2015, p. 125-138, con licenza Creative Commons CC-BY-SA, È consultabile on line qui: http://meson.press/books/alleys-of-your-mind/

Nel numero di settembre 2013 della rivista Nature, un gruppo di fisici dell’Università di Miami ha pubblicato un articolo intitolato “Aumento improvviso della nuova ecologia macchinica che supera il tempo di risposta umano”[i]. Hanno identificato una transizione verso una “nuova fase completamente ingegnerizzata”[ii] dei mercati finanziari, in coincidenza con l’introduzione del trading ad alta velocità sui mercati azionari nel 2006. Hanno dimostrato che velocità inferiori a un millisecondo così come quantità delle interazioni algoritmo-algoritmo erano ben oltre le capacità delle interazioni umane. Analizzando i dettagli dei dati raccolti su la scala del millisecondo nel cuore dei mercati finanziari, hanno scoperto un gran numero di micro-eventi anomali causati da questi algoritmi, la cui proliferazione sembrava loro correlata al crollo finanziario del 2008.

In questo nuovo ambiente del mercato azionario, gli agenti algoritmici prendono decisioni molto più velocemente di quanto gli esseri umani possano capire. Mentre un essere umano impiega un buon secondo per riconoscere e reagire a un potenziale pericolo, gli algoritmi (o “bot”) possono prendere una decisione in millisecondi. Questi algoritmi costituiscono “una complessa ecologia di agenti altamente specializzati, altamente diversificati con una forte capacità di interazione” che operano al limite dell’equilibrio, molto lontani dalla comprensione e dal controllo umani.

Questo articolo prenderà questa ecologia digitale degli algoritmi di trading ad alta frequenza come punto di partenza. Il mio testo, tuttavia, non tratterà specificamente di ecologia finanziaria, ma punterà più ampiamente a una discussione critica della cognizione automatica nell’era del capitalismo algoritmico. Se le transazioni finanziarie forniscono un esempio di automazione digitale che sta diventando sempre più indipendente dalle capacità di comprensione umana, questo sistema sta per diventare una seconda natura. Appare quindi urgente mettere in discussione il rapporto che il pensiero critico può mantenere con tali ecologie digitali. La critica della ragione strumentale, articolata dalla teoria critica ispirata da Francoforte, può ancora fare affidamento su una distinzione tra pensiero critico e automazione? Possiamo davvero dire che l’automazione algoritmica è tutt’oggi già una riduzione del pensiero critico?

A queste domande non si può rispondere senza affrontare un apparente dilemma: il pensiero filosofico e digitale si basa sui principi di indeterminatezza e incertezza, includendo questi principi al centro della teoria della complessità. Entrambi, quindi, si trovano a presentare sia una sfida che una definizione nella direzione dell’ordine neoliberista – che non è ultimo dei loro paradossi. Per analizzare questo paradosso, mi rivolgerò alla nozione di incomputabilità teorizzata dall’informatico Gregory Chaitin, il cui principale contributo al campo di ricerca della teoria algoritmica è la scoperta del numero incomputabile Omega. Questo numero ha la notevole qualità di essere definibile senza essere calcolabile. In altre parole, Omega definisce uno stato di calcolo che è sia discreto che infinito, che occupa lo spazio tra 0 e 1. Filosoficamente, la scoperta di Omega porta alla luce un processo di determinazione dell’indeterminato, processo che non implica una struttura di ragionamento a priori, ma il trattamento dinamico degli infiniti i cui risultati non sono inclusi nelle premesse logiche del sistema.

A queste domande non si può rispondere senza affrontare un apparente dilemma: il pensiero filosofico e digitale si basa sui principi di indeterminatezza e incertezza, includendo questi principi al centro della teoria della complessità. Entrambi, quindi, si trovano a presentare sia una sfida che una definizione nella direzione dell’ordine neoliberista – che non è ultimo dei loro paradossi. Per analizzare questo paradosso, mi rivolgerò alla nozione di incomputabilità teorizzata dall’informatico Gregory Chaitin, il cui principale contributo al campo di ricerca della teoria algoritmica è la scoperta del numero incomputabile Omega. Questo numero ha la notevole qualità di essere definibile senza essere calcolabile. In altre parole, Omega definisce uno stato di calcolo che è sia discreto che infinito, che occupa lo spazio tra 0 e 1. Filosoficamente, la scoperta di Omega porta alla luce un processo di determinazione dell’indeterminato, processo che non implica una struttura di ragionamento a priori, ma il trattamento dinamico degli infiniti i cui risultati non sono inclusi nelle premesse logiche del sistema.

Vorrei suggerire che il ruolo centrale svolto dall’incomputabile nella teoria dell’informazione sfida non solo la critica filosofica della razionalizzazione tecnica, ma anche le discussioni che ruotano attorno alla strumentalizzazione della ragione. Sosterrò che non è più sufficiente allinearci a una critica della tecnoscienza che denuncia il fatto che il calcolo riduce il pensiero umano a mere operazioni meccaniche. Invece, il paradosso che articola la filosofia realistica con il realismo del tecnocapitale può essere interpretato come un sintomo di una trasformazione irreversibile nella storia del pensiero critico, una trasformazione in cui la funzione incomputabile della ragione è penetrata nell’infrastruttura automatizzata della cognizione.

Gli algoritmi del capitale cognitivo e affettivo

Si ritiene che il capitale abbia permeato tutti gli aspetti della nostra vita personale e sociale. Prima di guardare al posto dell’incomputabile nell’automazione algoritmica, è importante ricordare che con la fase tecnocapitalista detta della “sussunzione reale del capitale”, l’automazione digitale è sempre più coestensiva con il capitale cognitivo e affettivo. La logica dell’automazione digitale è penetrata nelle sfere degli affetti e dei sentimenti, delle abilità linguistiche, delle modalità di cooperazione, così come delle forme di conoscenza e delle manifestazioni del desiderio. Ancora più radicalmente, si ritiene che il pensiero umano stesso sia diventato una funzione del capitale. Analisi contemporanee di questa nuova condizione, condotte in termini di “capitale sociale”, “capitale culturale” o “capitale umano”, ci spiegano che la conoscenza, l’intelligenza, le convinzioni e i desideri sono ridotti al loro valore strumentale e alla loro capacità di generare valore aggiunto. In questo regime automatizzato di affetti e conoscenza, le capacità sono misurate e quantificate all’interno di un campo definito in termini di denaro o d’informazioni. Raccogliendo dati e quantificando comportamenti, atteggiamenti e credenze, l’universo neoliberista dei derivati finanziari e dei big data fornisce una modalità di calcolo destinato a giudicare le azioni umane, nonché un meccanismo per incentivare e dirigere queste azioni.

Paradossalmente, proprio nel momento in cui il “lavoro immateriale” ha la precedenza sulla produzione materiale e quando il marketing è sempre più interessato ai beni emotivi/affettivi (come stati d’animo, stili di vita e “atmosfere”), il realismo capitalista sembra esprimersi senza incontrare alcun ostacolo, guidato dalle scoperte della psicologia cognitiva e della filosofia della mente[iii]. Al centro di queste prospettive c’è la plasticità delle strutture neuronali e la capacità di estendere le nostre funzioni cognitive attraverso macchine governate da algoritmi, dalla percezione alle abilità relative alla scelta e al giudizio. Si può affermare senza difficoltà che, oggi, il cervello sociale è costituito da un’ecologia macchinica di agenti algoritmici.

Bernard Stiegler ci invita a considerare il tecnocapitale da un punto di vista un po’ diverso. Secondo lui, il pensiero e il sentimento costituiscono nuovi motori di profitto che vengono repressi o catturati dal capitale, che li trasforma in semplici funzioni cognitive e sensoriali[iv]. In altre parole, il tecnocapitale appare come ciò che nega desiderio e conoscenza, ragione e sensazione, riducendo queste potenzialità a semplici probabilità determinate dal linguaggio binario di sì e no, di 0 e di 1. Spingendo ancora più a fondo le critiche, Maurizio Lazzarato ha affermato che una critica al tecnocapitale non può concentrarsi né sulla capitalizzazione della cognizione, né sulla sua automazione. In “La fabbrica dell’uomo indebitato”, sostiene che la conoscenza non detiene nessuna posizione egemonica nel ciclo del valore, perché la conoscenza (e quindi il pensiero) è soggetta al comando del capitale finanziario[v]. La forma neoliberale del capitale, nella sua attuale fase di sussunzione reale, corrisponde qui alla produzione di una nuova condizione, quella del debito generalizzato. Questa forma di governo neoliberista si è insinuata in tutte le classi sociali, comprese quelle che non hanno proprio nulla. Il nuovo rapporto di potere oggi prevalente è quindi quello che unisce il debitore al creditore. Il debito è una tecnologia governativa supportata da vari dispositivi automatici di misurazione e valutazione (tasso di indebitamento, rapporto debito/PIL, rapporto di credito, bilancio finanziario, database, ecc.). Lazzarato analizza questo regime assiomatico in termini di logica semiotica, il cui paradigma scientifico centrale e le cui applicazioni tecniche sono intese fin dall’inizio a cogliere, attraverso effetti di quantificazione del valore, le nostre primarie potenzialità estetiche.

In questa prospettiva, l’automazione è la logica semiotica per eccellenza, quella che non si accontenta di investire il lavoro nelle sue capacità cognitive e affettive, ma che diventa una forma di governamentalità, operando algoritmicamente per ridurre e soggiogare ogni forma di esistenza nella morsa generale del debito. Questa forma algoritmica di governabilità dà luogo anche a una diffusa finanziarizzazione delle potenzialità, attraverso la quale la vita estetica viene costantemente quantificata e tradotta in scenari del predittibile.

Brian Massumi ha anche notato la natura ecologicamente diffusa di questa nuova forma di governamentalità algoritmica, che descrive in termini di prelazione, cioè come un modo per calcolare le tendenze potenziali piuttosto che le possibilità attualmente esistenti[vi]. Il calcolo delle potenzialità rilevanti di questo tipo di dinamica non è più basato su dati passati già osservati. Piuttosto, mira a calcolare l’ignoto in quanto spazio relazionale, misurando l’intervallo che separa un dato esistente da un altro dato esistente. Questa forma di calcolo predittivo/prelativo trasforma il punto limite di questa operazione matematica – gli infiniti – in una fonte di capitalizzazione.

Da quanto sopra sembra emergere la seguente lezione: a differenza della logica della sussunzione formale, che corrisponde all’applicazione di regole invariabili la cui linearità mirava a formattare il sociale secondo idee preordinate, la logica della sussunzione reale coincide con il paradigma computazionale interattivo. Questo paradigma si basa sulle capacità di risposta all’apprendimento aperte e adattive, che definiscono le interazioni uomo-macchina nonché i sistemi interattivi diffusi e decentralizzati. Con questa estensione della quantificazione verso l’indeterminatezza degli ambienti – e quindi verso la contingenza – si è verificata una trasformazione intrinseca della logica di calcolo. In effetti, lo sviluppo di questo approccio interattivo ha svolto un ruolo cruciale nella forma di sussunzione reale che è ora dominante.

Da una prospettiva storica, sono stati inventati algoritmi interattivi per aggirare i vincoli algoritmici della macchina di Turing. Secondo il suo concetto, questa macchina non era in grado di tenere conto della complessità del mondo empirico – una complessità che, in termini filosofici, ha una sua logica non rappresentativa. In questo campo, il progresso della sussunzione reale non può essere separato dall’emergere di una forma automatica di automazione, caratteristica del momento di sviluppo storico delle scienze informatiche derivante dalla modellazione algoritmica di Turing. Quest’ultimo progettava meccanismi basati su istruzioni a priori che risuonavano fortemente con la definizione di macchinismo proposta dalla cibernetica del primo ordine, in quanto basati su sistemi a loop ricorsivi operanti in circuiti chiusi. Oggi, la combinazione di input ambientali e istruzioni a posteriori offerte dal paradigma interattivo ha aperto una cibernetica di seconda generazione [cibernetica di secondo ordine], caratterizzata dai meccanismi dei cicli ricorsivi aperti. Lo scopo di questo nuovo tipo di interazione dinamica è quello di includere variazione e novità nell’automazione, in modo da ampliare l’orizzonte della computazione e integrare fattori qualitativi come variabili esterne all’interno dei meccanismi stessi di computazione.

Contrariamente alle critiche formulate da Maurizio Lazzarato, però, sembra importante non attenersi a una visione generale dell’automazione, che la renderebbe una riduzione delle qualità esistenziali insite nel tecnocapitalismo. Piuttosto, la sfida è prendere la misura della trasformazione intrinseca del modo automatizzato di governamentalità neoliberista e affrontare seriamente la questione della tecnica. Tuttavia, invece di presumere che la tecnica imponga sempre un quadro formale statico delimitato dalla sua logica binaria, suggerisco che ci sia una dinamica interna nel sistema computazionale. Se questo è il caso, allora dobbiamo davvero porci la domanda speculativa che, secondo Isabelle Stengers, è centrale nel metodo scientifico[vii]: e se l’automazione mostrasse che esiste già una relazione dinamica intrinseca ai processi di calcolo, tra input di dati e istruzioni algoritmiche, che implica un’elaborazione non lineare dei dati? E se questa dinamica non potesse essere spiegata in termini di uso a posteriori, risultante da usi sociali o operazioni mentali?

Il paradigma interattivo riguarda la capacità degli algoritmi di rispondere e adattarsi a input esterni. Come aveva annunciato Deleuze[viii], un sistema interattivo di apprendimento e adattamento continuo è già al centro della logica della governance animata da un costante riassetto della variabilità. La centralità del capitalismo nelle nostre società costringe ormai gli assiomi ad aprirsi a output esterni, costituendo un ambiente di agenti attraverso i quali la logica di governo del capitale corrisponde sempre più strettamente ai più piccoli investimenti del socius e, in ultima analisi, alle variazioni più sottili della vita. La questione dell’indecidibile diventa di primaria importanza, perché definisce una visione immanente (e non trascendente) del capitale, come avevano sottolineato Deleuze e Guattari[ix]. È proprio così, poiché l’estensione del capitale a tutta la vita richiede che il suo apparato di cattura sia aperto a contingenze, variazioni e cambiamenti imprevisti.

È qui che il potere organizzativo del calcolo richiede un’analisi più dettagliata. Questa analisi è necessaria per poter chiarire la trasformazione osservata all’interno dell’automazione stessa, dovuta alla riorganizzazione del capitale da sussunzione formale a reale. L’automazione interattiva del cognitivo e affettivo deve essere riconsiderata da cima a fondo. Se ci atteniamo alla tradizionale critica del capitale cognitivo o alla denuncia della governance basata sull’indebitamento generalizzato, rischiamo di perdere quello che può essere considerato il processo più radicale di artificializzazione dell’intelligenza mai osservata nel corso della storia umana, quella che implica la conversione di scopi organici in mezzi tecnici – una conversione di cui stiamo solo cominciando a vedere le conseguenze.

I miei pensieri sono ancora in una fase embrionale, ma vorrei esplorare la possibilità di considerare l’automazione algoritmica come il preannunciare l’avvento di una seconda natura, all’interno della quale l’impersonale e il non finalizzato tende a soppiantare la finalità teleologica della ragione, così come Kant l’ha articolata in termini di massime e di motivazioni, vale a dire di ragione implicita dietro ogni azione, per dare sostanza alla differenza tra comprensione e ragione. Ciò che è più importante è che la mia ipotesi contesta la teoria secondo la quale esiste una relazione reciproca o una proposizione indecidibile tra filosofia e tecnologia, nonché tra pensiero e capitale.

La mia ipotesi va contro l’idea comune che, di fronte a un tecnocapitalismo sempre più dinamico, pensiero e filosofia siano chiamati a trovare rifugio nell’intuizione intellettuale e nel pensiero affettivo, come se questi fossero enclave protette dall’incertezza e dalla pura singolarità. Al contrario, vorrei suggerire la possibilità di vedere l’automazione algoritmica, come pensiero basato su regole, indifferente a queste qualità fin troppo umane, pur essendo in grado di avvolgerle senza mai rappresentare un pensiero filosofico o critico. La mia proposta è quindi quella di accogliere l’emergere di un modo di pensare algoritmico che non può essere contenuto all’interno di uno scopo teleologico della ragione – uno scopo teleologico che caratterizza sia il capitalismo che la critica del tecnocapitalismo.

L’esperimento di Turing e il numero Omega

Come è noto, l’automazione algoritmica implica l’analisi di processi continui in componenti discrete, le cui funzioni possono essere costantemente ripetute senza errori. In altre parole, l’automazione implica che le condizioni iniziali possano essere riprodotte all’infinito. Il tipo di automazione che qui ci interessa è nato con la macchina di Turing: un meccanismo di iterazione assoluto basato su procedure computazionali passo passo. Niente è più contrario al puro pensiero – o all ‘”essere del sensibile”, come lo chiamava Deleuze[x] – di questa macchina calcolatrice universale basata sulla discretizzazione degli elementi. È innegabile che l’architettura descritta da Turing, costituita da unità predisposte che possono sostituirsi reciprocamente in modo intercambiabile lungo sequenze, sia in realtà l’esatto opposto del pensiero ontogenetico che evolve attraverso un continuum differenziale, attraverso incontri e affetti/emozioni intensi.

Eppure, dagli anni ’60, la natura dell’automazione ha subito trasformazioni drammatiche con lo sviluppo delle nostre capacità computazionali di memorizzare ed elaborare i dati. Le macchine precedenti erano strettamente limitate dalla quantità di dati che potevano essere elaborati da cicli ricorsivi. L’attuale automazione algoritmica è ora progettata per analizzare e confrontare opzioni, per sviluppare scenari e testare possibili risultati e per mobilitare forme di ragionamento in grado di eseguire operazioni di risoluzione dei problemi non contenute nella memoria preprogrammata del sistema macchina. Ad esempio, i sistemi esperti possono oggi trarre conclusioni mobilitando tecniche di ricerca, riconoscimento di modelli, estrazione di dati sul web – al punto che questo tipo di sistemi automatizzati complessi è arrivato a investire e dominare la nostra cultura comune, dalle reti di telefonia mobile globali ai servizi bancari personalizzati e al controllo del traffico aereo.

Nonostante tali sviluppi, tuttavia, gran parte della nostra discussione sull’automazione algoritmica rimane fissa su un immaginario in stile Turing composto da macchine di calcolo discrete universali di prima generazione. Questo immaginario ci immerge nell’idea che l’automazione algoritmica sia solo un esempio tra i tanti del sogno di Laplace, dipingendo un universo che risponde a una causalità strettamente deterministica[xi]. All’interno della teoria computazionale, tuttavia, i calcoli di casualità o infinità hanno trasformato ciò che sembrava essere incomputabile in nuove forme di probabilità, che esibiscono la caratteristica notevole di essere sia discrete che infinite. In altre parole, mentre l’automazione algoritmica è stata intesa come appartenente a una macchina universale di calcolo discreto alla Turing, il volume crescente di dati incomputabili (o casuali) generati all’interno dei calcoli interattivi e diffusi attualmente gestiti online sta rivelandoci che dati infiniti privi di uno schema predeterminato sono in realtà centrali nei processi di calcolo. Per misurare il nuovo ruolo svolto da algoritmi incomputabili nel calcolo, è necessario fare una deviazione tramite il logico Kurt Gödel, che ha minato le affermazioni del metodo assiomatico della ragione pura dimostrando l’esistenza di proposizioni indecidibili all’interno della logica.

Nel 1931, Gödel formulò le sue obiezioni al programma meta-matematico di David Hilbert. Dimostrò che non poteva esistere un metodo assiomatico completo o una formula matematica pura, secondo cui si poteva dimostrare che la realtà delle cose era vera o falsa. I teoremi di incompletezza di Gödel spiegano che alcune proposizioni sono vere, anche se non possono essere verificate con un metodo assiomatico completo. Queste proposizioni sono quindi ritenute in ultima analisi indecidibili: non possono essere dimostrate secondo il metodo assiomatico su cui si basano le loro ipotesi. Secondo Gödel, il problema dell’incompletezza, derivante da uno sforzo per dimostrare la validità assoluta della ragione pura e del suo metodo deduttivo, finisce piuttosto per affermare il seguente principio: nessuna decisione a priori, e quindi nessun insieme finito di regole, non può essere utilizzato per determinare lo stato delle cose prima che queste cose possano accadere secondo il proprio sviluppo.

Turing inciampò nel problema dell’incompletezza di Gödel mentre cercava di formalizzare i concetti di algoritmo e computazione usando il suo famoso esperimento mentale, ora noto come “Macchina di Turing”. Più precisamente, la macchina di Turing dimostra che i problemi sono calcolabili se possono essere decisi secondo il metodo assiomatico[xii]. Al contrario, le proposizioni che non possono essere decise con il metodo assiomatico sono destinate a rimanere incomputabili.

Dimostrando che alcune funzioni particolari non possono essere calcolate da una macchina così ipotizzata, Turing dimostrò che non esiste un metodo decisionale definitivo del tipo che Hilbert voleva stabilire. La forza dell’affermazione avanzata da Turing sta nel fatto che la sua famosa macchina offriva una valida formalizzazione di un procedimento meccanico. Invece di limitarsi a far girare i numeri, le macchine computazionali di Turing – insieme alle macchine digitali contemporanee che si sono sviluppate da esse – possono risolvere problemi, prendere decisioni e svolgere compiti. L’unico requisito è che questi problemi, decisioni e compiti devono essere formalizzati attraverso simboli e un insieme di operazioni sequenziali discrete e finite. Da questo punto di vista, il lavoro di Turing può essere visto come un momento cruciale nella lunga serie di tentativi compiuti nella storia del pensiero per meccanizzare la ragione.

Ciò che è più importante, tuttavia, è capire come i limiti del calcolo, e quindi della finalità teleologica della ragione – automatizzata nella macchina di Turing – siano stati trasformati all’interno delle scienze del calcolo e della teoria dell’informazione. È il lavoro del matematico Gregory Chaitin che è particolarmente sintomatico di questa trasformazione, nello spiegare la posta in gioco entro i limiti del calcolo e nello sviluppo di una forma dinamica di automazione[xiii]. È fondamentale capire come questa trasformazione differisca dalla centralità del paradigma interattivo nel tecnocapitalismo. Come ha illustrato Brian Massumi, questo paradigma, nato dalla necessità di includere le contingenze ambientali nel calcolo, funziona principalmente anticipando o assegnando delle priorità alle possibili risposte. Ciò che è più importante, tuttavia, per la mia proposta di vedere l’automazione algoritmica come un modo di pensare, è che questa trasformazione coinvolge la stessa funzione che i dati incomprensibili giocano all’interno del calcolo. Tuttavia, non si può comprendere questo punto cruciale senza spiegare la teoria di Chaitin in modo un po’ più dettagliato.

La teoria dell’informazione algoritmica sviluppata da Gregory Chaitin si occupa del calcolo in termini di probabilità altamente inconoscibili. Pone il problema combinando la domanda di Turing sul limite della computabilità con la teoria dell’informazione di Claude Shannon, che dimostra la capacità produttiva del rumore e della casualità nei sistemi di comunicazione. In ogni processo computazionale, spiega, l’output è sempre maggiore dell’input. Secondo Chaitin, nell’elaborazione computazionale dei dati accade qualcosa, qualcosa che mette in discussione l’equivalenza tra input e output e, di conseguenza, l’idea stessa che l’elaborazione porti sempre a un risultato pre-programmato. Quel qualcosa, secondo Chaitin, è la aleatorietà algoritmica. Questa nozione implica che le informazioni non possono essere compresse in un programma più piccolo, poiché una trasformazione entropica dei dati avviene tra l’input e l’output, il che si traduce nel fatto che questi dati tendono a aumentare la loro dimensione. Da questo punto di vista, l’output dell’elaborazione dei dati non corrisponde alle istruzioni iniziali dell’input e il suo volume tende effettivamente a diventare più grande di quanto non fosse all’inizio del calcolo. La scoperta della aleatorietà algoritmica nell’elaborazione computazionale è stata spiegata da Chaitin in termini di non computabile, ovvero la quantità crescente, sebbene sconosciuta, di dati che caratterizzano l’elaborazione basata su regole.

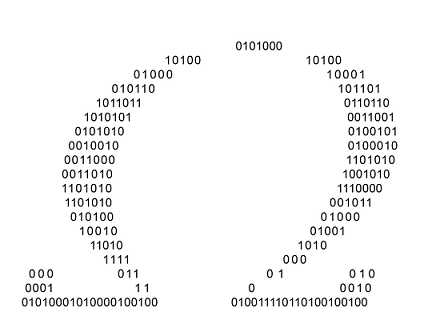

Chaitin chiama questa aleatorietà algoritmica Omega (l’ultima lettera dell’alfabeto greco si riferisce alla probabilità che questo numero sia infinito). L’indagine di Chaitin sull’incomputabile rivela infatti che l’ordine lineare delle procedure sequenziali (vale a dire, ciò che costituisce l’elaborazione computazionale di zeri e uno) mostra una tendenza entropica ad aggiungere più dati all’aggregazione esistente di istruzioni stabilite all’ingresso. Poiché questa elaborazione include inevitabilmente non solo una trasformazione dei dati esistenti in nuovi input, ma anche l’aggiunta di nuovi dati oltre a quanto già prestabilito nella procedura computazionale, è possibile parlare di una dinamica interna al calcolo.

Da questo punto di vista, l’elaborazione computazionale non garantisce principalmente il ritorno alle condizioni iniziali, né include semplicemente il cambiamento derivato da un paradigma interattivo basato su output reattivi. Questo perché la concezione di incomputabilità di Chaitin non corrisponde più perfettamente alla nozione di limite nel calcolo (cioè, limite per ciò che è calcolabile). Invece, questo limite come l’incomputabile si trasforma: diventa l’aggiunta di parti algoritmiche nuove e al massimo inconoscibili al corso attuale dell’elaborazione computazionale; queste parti sono sequenze algoritmiche che tendono a diventare più grandi di volume rispetto all’istruzione programmata e a subentrare, trasformando così irreversibilmente la finalità prefissata delle regole. La riarticolazione dell’incomputabile di Chaitin è allo stesso tempo sorprendente e speculativamente produttiva. Quello che era concepito come il limite esterno del calcolo (cioè l’incomputabile) in Turing, è ora diventato interiorizzato nella disposizione sequenziale degli algoritmi (la aleatorietà funziona all’interno delle procedure algoritmiche).

Per stessa ammissione di Chaitin, è necessario vedere la aleatorietà algoritmica come una continuazione del tentativo di Turing di spiegare l’indeterminatezza nel calcolo. Mentre per Turing ci sono casi in cui la finalità non può essere raggiunta, e quindi il calcolo – in quanto automazione della finalità della ragione – si ferma quando inizia l’incomputabile, per Chaitin il calcolo stesso ha un margine interno di incomputabilità in quanto le regole sono sempre accompagnate e infettate da aleatorietà. Quindi, l’incomputabilità non è semplicemente una rottura con la ragione, ma piuttosto la ragione è stata ampliata oltre i suoi limiti per coinvolgere l’elaborazione di parti al massimo sconosciute che non hanno finalità teleologiche. Per dirla in altri termini, l’automazione è ora delimitata dall’incomputabile, dall’incondizionato del calcolo.

Ma forse la cosa più importante è altrove: quanto è stato appena detto mette in discussione l’opinione comune che l’elaborazione computazionale corrisponda a calcoli che portano a risultati preprogrammati e già noti. Invece, i limiti dell’automazione – ovvero l’incomputabile – sono diventati il punto di partenza di una dinamica interna al calcolo, una dinamica che va oltre e oltre il progetto di strumentalizzazione della ragione da parte del tecnocapitale. Mettere in relazione le scoperte di Chaitin con le posizioni del pensiero critico e del tecnocapitalismo rivela ancora un altro aspetto cruciale della nostra situazione: l’incomputabile non può essere inteso semplicemente come opposto alla ragione. In altre parole, non è l’espressione di un punto terminale della ragione e non può essere spiegato dalla prospettiva critica che rivendica il primato del pensiero affettivo.

Secondo Chaitin, l’incomputabile dimostra le inadeguatezze della visione meccanicistica della computazione, secondo la quale il caos e la casualità costituiscono errori all’interno della logica formale della computazione. Gli incomputabili non descrivono in alcun modo il fallimento dell’intelligibilità di fronte al trionfo dell’incalcolabile, anzi. Questi limiti suggeriscono molto più sottilmente la possibilità di una dinamica di intelligibilità, definita dalla capacità di infiniti incomprensibili o dell’aleatorio di infettare qualsiasi insieme computabile o discreto. In altre parole, la aleatorietà (o infinite varietà di infiniti) non è solo al di fuori del calcolo, ma arriva ad apparire più radicalmente come la sua condizione assoluta. E quando diventa parzialmente intelligibile nel simbolo algoritmico che Chaitin chiama Omega, la aleatorietà penetra anche nell’ordine computazionale e provoca una revisione irreversibile delle regole algoritmiche e del loro scopo teleologico. È proprio questa nuova possibilità di revisione indefinita delle regole, guidata dall’inclusione della aleatorietà nel calcolo, che rivela la dinamica operante tra un sistema automatizzato e il pensiero automatizzato. Questo porta ad un’altra importante implicazione: mentre la scoperta di Omega di Chaitin dimostra che la aleatorietà è diventata intelligibile all’interno del calcolo, gli incomputabili non possono tuttavia essere sintetizzati da un programma a priori o da un insieme di procedure che sono di dimensioni inferiori a loro. Secondo Chaitin, Omega corrisponde a stati discreti che sono essi stessi composti da infiniti numeri reali che non possono essere contenuti da assiomi finiti. Ciò che dovrebbe interessarci qui è il fatto che il numero Omega di Chaitin è simultaneamente intelligibile e tuttavia non sintetizzabile – né dagli universali, né da un soggetto. Da ciò suggerisco che la computazione, come meccanizzazione del pensiero, è intrinsecamente popolata di dati incomprensibili e che le regole discrete sono aperte a qualche forma di contingenza interna all’elaborazione algoritmica. Questo non dovrebbe essere inteso come un errore nel sistema o un problema tecnico nella struttura del codice, ma piuttosto come parte del calcolo stesso. Lungi dallo squalificare il calcolo come incarnazione fatale del modo in cui il tecnocapitalismo strumentalizza la ragione, siamo invitati a renderci conto che emergono algoritmi incomputabili per sfidare la superiorità della finalità teleologica della ragione, così come quella del pensiero sensibile ed affettivo.

Calcolo speculativo.

Sarebbe sbagliato vedere questa affermazione secondo cui gli incomputabili definiscono la forma dinamica dell’automazione con ingenuo entusiasmo. Invece, è importante affrontare l’automazione algoritmica senza trascurare il fatto che il calcolo dell’infinito è nondimeno centrale per la capitalizzazione delle capacità intelligibili, anche nella loro forma automatizzata. La mia insistenza sul fatto che gli incomputabili non sono esclusivamente quegli infiniti non rappresentabili, che appartengono all’essere del sensibile, è infatti una preoccupazione, con la trasformazione ontologica ed epistemologica del pensiero in vista della funzione algoritmica della ragione. Gli incomputabili sono espressi dalle capacità affettive di produrre nuovo pensiero, ma soprattutto rivelano la natura dinamica dell’intelligibile. Qui, la mia preoccupazione non è un appello a un essere computazionale definitivo che determina la verità del pensiero. Al contrario, mi sono rivolto alla scoperta di Omega di Chaitin, perché disfa radicalmente il fondamento assiomatico della verità rivelando che il calcolo è un affare incompleto, aperto alla revisione delle sue condizioni iniziali, e quindi alla trasformazione di verità e finalità. Poiché Omega è allo stesso tempo una probabilità discreta e infinita, testimonia il fatto che la condizione iniziale di una simulazione – basata su passi discreti – è e può essere infinita. In breve, gli algoritmi incomputabili scoperti da Chaitin suggeriscono che la complessità dei numeri reali sfida il fondamento della ragione nell’assiomatica finita e nella finalità teleologica.

Da questo punto di vista, diverse conseguenze si possono trarre. Concordo sul fatto che il paradigma interattivo del tecnocapitalismo punti già a una forma semi-dinamica di automazione, che ha asservito le capacità cognitive e affettive e stabilito una governamentalità finanziaria basata sul debito. Ma oltre a questo, rimangono ancora ulteriori domande sul significato degli algoritmi. Se rischiamo di confondere la netta opposizione tra digitale e filosofia[xiv], la questione che si pone è cosa e come sono gli algoritmi? Per ora, voglio sottolineare che gli algoritmi, questa forma dinamica della ragione, basata su regole e tuttavia aperta a essere rivista, non sono definiti dalla finalità teleologica, poiché le funzioni impersonali trasformano ogni volta tale finalità. Questo non deve essere concepito come una mera sostituzione o estensione delle funzioni cognitive umane. Invece, il mio proposito è di suggerire che stiamo assistendo alla configurazione di un modo di pensiero incomputabile che non può essere sintetizzato in una teoria o in un programma totalizzante. Tuttavia, questo pensiero mette a nudo la fallacia della filosofia e della teoria critica, che riducono la computazione a una meccanizzazione inferiore della ragione, destinata alla mera iterazione e incapace di mutarne le direzioni finali.

Qui, la mia argomentazione riguardava principalmente la critica della computazione come incarnazione della strumentalizzazione tecnocapitalista della ragione. Ho tentato di suggerire la possibilità che l’automazione algoritmica coincida con un modo di pensare, in cui l’incomputabile o la aleatorietà sono diventati intelligibili, calcolabili ma non necessariamente totalizzabili dal tecnocapitalismo. Nonostante tutta la strumentalizzazione della ragione a favore del capitalismo, e nonostante la repressione della conoscenza e del desiderio in quantità, come compiti, funzioni, scopi, rimane certamente un’incongruenza all’interno del calcolo. Questo è il caso in quanto più calcola, maggiore è la aleatorietà (informazione priva di schemi) che crea, il che espone le capacità di trasformazione delle funzioni basate su regole. Nella transizione di fase da algoritmo ad algoritmo che più notoriamente caratterizza il trading finanziario menzionato all’inizio di questo saggio, è difficile ignorare la possibilità che l’automazione del pensiero abbia superato la rappresentazione e abbia invece rivelato che il calcolo stesso è diventato dinamico.

Per concludere voglio aggiungere questo: l’automazione dinamica non può essere spiegata principalmente in termini di una relazione farmacologica necessaria tra filosofia e tecnologia, conoscenza e capitale, non più che come il veleno condizionale che consente una reversibilità reciproca definita da un terreno comune come pretende Stiegler. Allo stesso modo, bisogna ammettere che le tendenze dinamiche alla base dell’automazione algoritmica non sono semplicemente riducibili alla logica tecnocapitalista dell’organizzazione semiotica, come ha detto Lazzarato, né allo sfruttamento/repressione delle funzioni cognitivo-creative del pensiero.

La sfida che la cognizione automatizzata pone alla visione post-umana – che pensiero e tecnologia sono diventati una cosa sola, a causa del tecnocapitalismo – indica l’emergere di un nuovo modo di pensare alieno, in grado di cambiare le sue condizioni iniziali e di esprimere fini che non lo fanno corrispondere alla finalità del pensiero organico. Ciò significa anche che la transizione di fase da algoritmo ad algoritmo non rimane semplicemente un altro esempio della strumentalizzazione tecnocapitalista della ragione, ma rivela più sottilmente una realizzazione di una seconda natura sotto forma di un’intelligenza automatizzata e senza scopo. Se l’automazione algoritmica non corrisponde più all’esecuzione di istruzioni, ma alla costituzione di una macchina ecologica infettata dalla aleatorietà, allora si può suggerire che né il tecnocapitalismo né la critica del tecnocapitalismo possono contenere la tendenza dell’elaborazione automatizzata della aleatorietà a superare le verità assiomatiche.

[i] Questo articolo di Luciana Parisi è comparso originariamente in inglese «Instrumental Reason, Algorithmic Capitalism, and the Incomputable» in, a cura di Matteo Pasquinelli Augmented Intelligence Trauma. Alleys of Your Mind, Meson Press, Lüneburg, 2015, p. 125-138, con licenza Creative Commons CC-BY-SA, È consultabile on line qui: http://meson.press/books/alleys-of-your-mind/. Multitudes.

[ii] Neil Johnson et al., «Abrupt Rise of New Machine Ecology beyond Human Response Time», Scientific Reports 3 (September 11, 2013).

[iii] Su questi vari punti, cfr. Antonio Negri e Michael Hardt, Empire, Exil, Paris, 2000; Brigitte Biehl-Missal, «Atmospheres of Seduction: A Critique of Aesthetic Marketing Practices», Journal of Macromarketing, vol. 32 (2), 2012, p. 168-180; Mark Fisher, Capitalist Realism. Is There No Alternative?, Zero Books, Londres, 2009.

[iv] Cfr Bernard Stiegler, Mécréance et discrédit, tome 3: L’esprit perdu du capitalisme, Galilée, Paris, 2006, et État de choc: bêtise et savoir au XXIe siècle, Mille et une nuits, Paris, 2012.

[v] Maurizio Lazzarato, La fabrique de l’homme endetté, Éditions Amsterdam, Paris, 2011 Trad. italiano, La fabbrica dell’uomo indebitato, DeriveApprodi, Roma 2012.

[vi] Brian Massumi, «Potential Politics and the Primacy of Preemption», Theory & Event 10 (2), 2007; cfr, in francese, «Le politique court-circuité: préemption et contestation», Multitudes, no50, 2012, p. 49-53.

[vii] Isabelle Stengers, Cosmopolitiques 1 [1997], La Découverte, Paris, 2003.

[viii] Gilles Deleuze, «Post-scriptum sur les sociétés de contrôle», Pourparlers, Minuit, Paris, 1990

[ix] Gilles Deleuze et Félix Guattari, Mille Plateaux, Minuit, Paris, 1980.

[x] Gilles Deleuze, Différence et répétition, PUF, Paris, 1968.

[xi] Cfr. Giuseppe Longo, «The Difference between Clocks and Turing Machines», in Arturo Carsetti, (éd.), Functional Models of Cognition. Self-Organizing Dynamics and Semantic Structures in Cognitive Systems, Springer, Dordrecht, 2000, p. 211-232, et « Laplace, Turing and the «Imitation Game» Impossible Geometry: Randomness, Determinism and Programs in Turing’s Test», in Robert Epstein et al. (éd.), The Turing Test Sourcebook, Kluwer, Dordrecht, 2007, p. 377-413.

[xii] Cfr, Alan Turing, «On Computable Numbers, with an Application to the Entscheidungsproblem», Proceedings of the London Mathematical Society, series 2, vol. 42, 1936, p. 230-65. Per maggiori dettagli su l’intreccio tra il lavoro di Hilbert, Gödel et Turing, cfr. Martin Davis, The Universal Computer. The Road from Leibniz to Turing, Norton and Company, Londres, 2000, p. 83-176.

[xiii] Cfr Gregory Chaitin, « Leibniz, Randomness & the Halting Probability », Mathematics Today 40 (4), 2004, p. 138-39; «The Limits of Reason», Scientific American 294 (3), 2006, p. 74-81; «The Halting Probability Omega: Irreducible Complexity in Pure Mathematics», Milan Journal of Mathematics 75 (1), 2007, p. 291-304.

[xiv] Alexander Galloway, «The Poverty of Philosophy: Realism and Post-Fordism», Critical Inquiry 39 (2), 2013, p. 347-366.

References

Biehl-Missal, Brigitte. 2012. “Atmospheres of Seduction: A Critique of Aesthetic Marketing Practices.” Journal of Macromarketing 32 (2): 168–80.

Chaitin, Gregory. 2004. “Leibniz, Randomness & the Halting Probability.” Mathematics Today 40 (4): 138–39.

Chaitin, Gregory. 2006. “The Limits of Reason.” Scientific American 294 (3): 74–81.

Chaitin, Gregory. 2007. “The Halting Probability Omega: Irreducible Complexity in Pure Mathematics.”Milan Journal of Mathematics 75 (1): 291–304.

Davis, Martin. 2000. The Universal Computer. The Road from Leibniz to Turing. London: Norton and Company, 83–176.

Deleuze, Gilles, and Félix Guattari. 1987. A Thousand Plateaus: Capitalism and Schizophrenia. Minneapolis: University of Minnesota Press.

Deleuze, Gilles. 1994. Difference and Repetition. London: Athlone.

Deleuze, Gilles. 1992: “Postscript on the Societies of Control.” October 59: 3–7.

Farmer, Doyne, and Spyros Skouras. 2011. An Ecological Perspective on the Future of Computer Trading. The Future of Computer Trading in Financial Markets, UK Foresight Driver Review 6. London: Government Office for Science. http://www.gov.uk/government/uploads/system/uploads/attachment_data/file/289018/11- 1225-dr6-ecological-perspective-on-future-ofcomputer-trading.pdf.

Fisher, Mark. 2009. Capitalist Realism. Is There No Alternative?. London: Zero Books.

Galloway, Alexander. 2013. “The Poverty of Philosophy: Realism and Post-Fordism.” Critical Inquiry 39 (2): 347–66.

Goldstein, Rebecca. 2005. Incompleteness: The Proof and Paradox of Kurt Gödel. Norton&Company.

Gödel, Kurt. 1995. “Some basic theorems on the foundations of mathematics and their implications.” In Collected Works of Kurt Gödel. Vol. 3, edited by Solomon Feferman et al., 304–23. Oxford: Oxford University Press.

Hardt, Michael and Negri, Antonio. 2000. Empire. Cambridge, MA: Harvard University Press.

Hayles, N. Katherine. 2014. “Cognition Everywhere: The Rise of the Cognitive Nonconscious and the Costs of Consciousness.” New Literary History 45 (2): 199–320.

Johnson, Neil, Guannan Zhao, Eric Hunsader, Hong Qi, Nicholas Johnson, Jing Meng, and Brian Tivnan. 2013. “Abrupt Rise of New Machine Ecology beyond Human Response Time.” Scientific Reports 3 (September 11). doi:10.1038/srep02627.

Lazzarato, Maurizio. 2012. The Making of the Indebted Man. Los Angeles: Semiotext(e).

Longo, Giuseppe. 2000. “The Difference between Clocks and Turing Machines.” In Functional Models of Cognition. Self-Organizing Dynamics and Semantic Structures in Cognitive Systems, edited by Arturo Carsetti, 211–232. Dordrecht: Springer.

Longo, Giuseppe. 2007. “Laplace, Turing and the ‘Imitation Game’ Impossible Geometry: Randomness, Determinism and Programs in Turing’s Test.” In The Turing Test Sourcebook, edited by Robert Epstein, Gary Roberts and Grace Beber, 377–413. Dordrecht: Kluwer.

Massumi, Brian. 2007. “Potential Politics and the Primacy of Preemption.” Theory & Event 10 (2).

Steiner, Christopher. 2012. Automate This: How Algorithms Came to Dominate the World. New York: Portfolio/Penguin.

Stengers, Isabelle. 2010. Cosmopolitics 1. Minneapolis: University of Minnesota Press.

Stengers, Isabelle. 2011. Cosmopolitics 2. Minneapolis: University of Minnesota Press.

Stiegler, Bernard. 2014. States of Shock: Stupidity and Knowledge in the 21st Century. Cambridge: Polity Press.

Stiegler, Bernard. 2014. The Lost Spirit of Capitalism: Disbelief and Discredit, 3. Cambridge: Polity Press.

Turing, Alan. 1936. “On Computable Numbers, with an Application to the Entscheidungsproblem.” Proceedings of the London Mathematical Society, series 2, vol. 42, 230–65

*Traduzione di Gilberto Pierazzuoli

Luciana Parisi

Ultimi post di Luciana Parisi (vedi tutti)

- La ragione strumentale, il capitalismo algoritmico e l’incomputabile. - 10 Gennaio 2021