Per una critica del capitalismo digitale – VI parte

L’accumulo dei dati avvenuto anche per ragioni formali, è la materia prima a basso costo di cui il capitale digitale si appropria (vedi anche qui e qui). Il passaggio al digitale già dagli anni novanta del secolo scorso di diverse apparecchiature mediche riservate agli esami, ha trasformato la medicina in una pratica generatrice di grandi volumi di dati. Abbiamo già visto che il data mining può essere usato sia in termini descrittivi di un fenomeno, ma anche in termini predittivi, nonché per uno screening utile per altre piattaforme. I dati medici sono interessanti per la descrizione di una popolazione, per un’analisi del livello di stato sociale, per la valutazione complessiva del sistema sanitario. I dati personali invece possono interessare un’assicurazione sulla vita, l’assicurazione medica in senso stretto in paesi come gli Stati Uniti dove non c’è un servizio sanitario pubblico e dove se non si ha un’adeguata assicurazione dovremmo pagare l’intera parcella della prestazione sanitaria della quale abbiamo usufruito. Semplicemente, la sanità è un terreno nel quale la tutela della privacy si fa molto delicata. Il business digitale si alimenta di dati. Le cartelle mediche, le analisi, le radiografie e consimili li forniscono e – nello stesso tempo, tramite la loro elaborazione – possono essere di aiuto per la loro lettura. Ma non basta, i dispositivi indossabili utili per pianificare gli allenamenti o per monitorare le pulsazioni come gli smart watch o simili, ne forniscono di ulteriori, alimentando i data base delle aziende sanitarie come di quelle del fitness.

Ma non solo, le condizioni di salute degli individui interessano ogni operazione di profilazione degli utenti. I processi di deep learning lavorano cercando correlazioni, anche provenienti da ambiti diversi, per formulare le loro ipotesi interpretative. Ogni associazione abbastanza ricorsiva è materia di apprendimento anche se si discosta dal sapere umano. L’intelligenza della macchina può essere al limite confrontata con quella animale in termini quantitativi, di potenza, ma non qualitativi. La macchina pensa in maniera diversa. Le reti neurali artificiali sono un blando tentativo di riprodurre il funzionamento di quelle biologiche, ma come abbiamo visto, lasciando alla macchina la possibilità di costruirsi autonomamente una sua strategia, il risultato migliora (AlphaGo contro AlphaGo Zero). Il pensiero macchinico e quello biologico di fatto divergono.

Ma non solo, le condizioni di salute degli individui interessano ogni operazione di profilazione degli utenti. I processi di deep learning lavorano cercando correlazioni, anche provenienti da ambiti diversi, per formulare le loro ipotesi interpretative. Ogni associazione abbastanza ricorsiva è materia di apprendimento anche se si discosta dal sapere umano. L’intelligenza della macchina può essere al limite confrontata con quella animale in termini quantitativi, di potenza, ma non qualitativi. La macchina pensa in maniera diversa. Le reti neurali artificiali sono un blando tentativo di riprodurre il funzionamento di quelle biologiche, ma come abbiamo visto, lasciando alla macchina la possibilità di costruirsi autonomamente una sua strategia, il risultato migliora (AlphaGo contro AlphaGo Zero). Il pensiero macchinico e quello biologico di fatto divergono.

In ambito medico la soluzione delle problematiche, la cura, la terapia messa in atto, dipendono moltissimo dalla produzione privata. Macchinari, farmaci, e spesso le procedure stesse sono in mano ai privati. Si è infatti parlato di patologizzazione di questo o quel comportamento, di questo o quel fenomeno per meri fini commerciali. Chi ci dice che le associazioni e le corrispondenze portate in luce dalla attività estrattiva dell’algoritmo facciano riferimento a una vera e propria patologia? Un esempio e un problema sono la proliferazione di disturbi “certificati” dell’apprendimento riscontrata nelle scuole. Così come il trattamento chimico dei disagi comportamentali. E se l’algoritmo trovasse delle disfunzioni a livello delle preferenze sessuali reinventandosi la patologizzazione della omosessualità? Se guardiamo bene, è facile che si abbia un risultato che nasce dallo scarto di tutto quello che è minoritario perché, come dicevamo sopra, devianza statistica. Così come certe devianze vengano invece prese in considerazione in vista di applicare loro la cura dovuta in termini di medicalizzazione o di esclusione sociale se non addirittura di repressione con restrizione della libertà. E come si comporterà l’algoritmo che deve in prima istanza massimizzare il profitto?

Ma anche in una chiave semplificata, la sanità è un terreno nel quale la tutela della privacy può essere molto delicata, ma è anche un terreno dove i profitti possono essere cospicui. Ecco il “Machine Federated Learning” che è un modo per Google – che ne ha descritte le potenzialità in un articolo del 2017 – di poter accedere a un enorme mole di dati come d’altronde aveva già fatto senza chiedere il permesso. È un modo di analizzare i dati come se fossero contenuti in un solo “recipiente” anche se nella realtà sono in possesso esclusivo di diversi attori che non possono per legge scambiarseli e/o renderli pubblici. Esso mira a costruire un modello tra le organizzazioni, mentre i dati in possesso di ognuna rimangono in azienda, il loro ambiente locale e i parametri del modello sono infatti scambiati in maniera cifrata. Il sistema, pur non essendo prestazionalmente pari al Machine Learning tradizionale permette di lavorare anche nell’ambito sanitario. Bisogna tenere presente che parliamo di un mercato che vale globalmente 7,724 miliardi di dollari e che nel 2022 dovrebbero raggiungere quota 10,059. Avere una grande quantità di dati è una delle prime condizioni per arrivare ad algoritmi efficaci.

L’IBM che non costruisce più i personal computer, ma che lavora di più sul lato software, ha creato Watson, un data base complesso di dati sanitari, ma anche un sistema di elaborazione degli stessi. Watson fa anche diagnosi. È per esempio capace di trovare un tumore della pelle con gradi di precisione considerati superiori a quelli dei medici umani. Si espleta qui una delle funzioni aletheiche della Intelligenza Artificiale che confeziona rivelazioni celate al nostro percepire, al nostro intelletto. A caratterizzare questo ambito della ricerca è il fatto che i lavori non provengono dal mondo della medicina, ma da attori industriali, dice Sadin (citato anche precedentemente). Non si tratta di un partenariato tra i due mondi anche per il fatto che i risultati ottenuti devono essere venduti agli addetti originali. Ma il potere della macchina in campo sanitario si estende anche all’ambito prescrittivo. Certamente la conoscenza di tutti i farmaci e la loro minuta composizione sono più a portata di un’entità meccanica che non di una biologica. La macchina sa certamente pescare in questo enorme cumulo di dati in maniera più accurata, aggiornata, dosata di un umano; la sua funzione potrebbe essere così collaborativa, ma gli interessi in gioco sono quelli che prevedono anche la diagnosi e la prescrizione da fare autonomamente e automaticamente.

Quando la macchina lavora in prima persona, realizza il sogno delle case farmaceutiche che da tempo hanno messo in atto ogni specie di espediente per invogliare i medici a preferire i loro prodotti. L’intento è quello di bypassare i medici per imporre di fatto i prodotti proprietari. L’industria cerca così di interfacciarsi direttamente con il cliente (utente, paziente). Se è vero che prevenire è meglio che curare, il capitalismo digitale si appropria di entrambi gli aspetti della questione. Quello che poca interessa è la guarigione del malato. Con la guarigione cessa il rapporto di mercato con il cliente. L’ideale sarebbe il malato cronico ed è proprio su questo che ha agito la mano invisibile del mercato. Ma anche la prevenzione non è affare da poco. Occorre raccogliere il maggior numero dei dati sui corpi. Quell’orologio che ti faceva da coach per gli allenamenti, misura il battito cardiaco, la qualità del sonno, quanti passi fai, dove e quando li fai, L’ultimo smart watch della Asus fa anche l’elettrocardiogramma. Il tecno liberismo intende ora appropriarsi delle competenze dei medici. Ecco Google Health e Calico (sempre Gruppo Google “Alphabet”), HealthKit, CareKit, ResearchKit (Apple). Si producono App e accessori che misurano la temperatura corporea, la sudorazione, fanno l’analisi delle frequenze vocali e della tosse. Si forniscono addirittura kit per l’analisi del sangue. Il monitoraggio perenne, sostituisce l’evento della visita. Se nella concezione analogica della malattia, questa era uno stato di eccezione da curare per riportare il soggetto all’interno di una normalità prescritta. Luogo dove comunque operavano i dispositivi di controllo, cura e assoggettamento. La continuità della cura permessa dai prodotti (dalle merci) digitali, stravolge l’assunto. La prevenzione diviene cronicizzazione. La cura diventa perenne.

Collocando quindi la “cura” in questi nostri tempi, in questo universo digitale: «Gli attori industriali raccolgono lo stato di salute delle persone attraverso oggetti connessi e applicazioni dedicate, propongono loro prodotti e servizi di benessere, possono prescrivere esami complementari da fare presso i loro laboratori o presso quelli che hanno acquistato le parole chiave corrispondenti, e chiudono il cerchio proponendo loro stessi delle terapie (Sadin, p. 81).

La malattia descrive uno stato del corpo. In teoria la diagnosi ne fotografa proprio lo stato individuando in che cosa differisce da quello naturale. Lo stato del corpo è un continuum, è un incrocio di infinite relazioni tra flussi e organi ed è in continuo divenire. La diagnosi – nella medicina occidentale – descrive invece un frame o uno spezzone dove è contenuta l’alterazione: è una segmentazione di quel continuum. Si concentra su una parte di una fisiologia complessa. La diagnosi diviene un’iscrizione ad una patologia riconosciuta, consolidata. Ma questo fenomeno (la malattia) non è detto che abbia sempre dei confini precisi o che si manifesti sempre in termini definiti e perfettamente sovrapponibili. La diagnosi ha dei descrittori che per quanto tentino di scontornarla non possono matematicamente circoscrivere. E il farmaco agisce spesso su alcuni di questi descrittori, ma con possibili effetti collaterali difficilmente interpretabili. Questo diciamo è un difetto della medicina occidentale. Un difetto per eccesso tassonomico al quale spesso supplisce il medico umano che si relaziona o che si dovrebbe relazionare al paziente. Il medico non umano, il medico algoritmico acutizza e amplifica questa proprietà, questo difetto. Imporrà una verità obiettiva con raccomandazioni che assumeranno il valore di enunciati prescrittivi con l’allure di essere superiormente qualificati.

Il medico interagendo con il malato cerca di cogliere oltre a quel segmento dell’alterazione, le connessioni che fanno di quel corpo astratto un corpo concreto. Potrà decidere per un farmaco, ma anche su più farmaci, se non su una ricetta comportamentale (riposo, particolare esercizio fisico). Anche la diagnosi è relazionale.

Verily (universo Google) nel 2017 ha reclutato 10.000 volontari che hanno accettato di indossare dei sensori e di sottoporsi per quattro anni a prelievi regolari al fine di fornire dati sulla loro salute e sulle loro eventuali patologie. Lo scopo è quello dell’individuazione di biomarcatori che possano indicare i segni premonitori delle patologie. Sembra una buona cosa se non fosse che il mondo digitale tende a trasformare il divenire biologico, l’essere analogico della vita in una serie di campionamenti, che restituiscono marcatori validi statisticamente con controlli ed esclusioni per ogni elemento che si discosta dalla norma. Non colgono il divenire della malattia, ma i singoli stadi, operando poi una specie di sineddoche metodologica, una parte per il tutto, ma anche il contrario: la media statistica per il singolo caso. La media statistica non è quella che in realtà si manifesta, al limite non si potrebbe mai manifestare, la realtà è fatta di singoli casi. Se la media di possessori di case è per esempio di cinque, può essere che nel campione esaminato nessuno ne possieda realmente cinque, ma che ce ne siano pochi che ne possiedono molte di più e tanti molte di meno. Per questo l’algoritmo può escludere una sintomatologia a bassa frequenza, ma che si può egualmente manifestare e transitare in una patologia anche grave. Il senso fondamentalmente è il fatto che questi strumenti tecnici avrebbero un valore diverso se fossero pensati come coadiuvanti, in realtà la forma mentis, che li sottende è quella di una visione pervasiva che esclude l’umano per permettere al dispositivo di operare automaticamente. I dispositivi indossati dai volontari del progetto Verily, saranno i nuovi gadget da dover indossare per avere cura di se. Una cura questa volta così tanto personalizzata che va a costruirti un profilo che ti assoggetta al progetto macchinico che il capitale sta mettendo in piedi. I tuoi dati saranno preziosi per produrre più merci a te indispensabili che, in un circolo vizioso (virtuoso per il profitto), produrranno più dati per un loop che realizza il sogno capitalista di un infinito ripetersi dell’accumulo originale.

Luca Pampaloni, a proposito del comportamento di alcuni amministratori della sanità nei confronti dei disabili nota che il sistema dominato dal profitto, il capitale, vuole ora «appropriarsi di tutto il settore del cosiddetto “lavoro riproduttivo” – cioè quelle attività non immediatamente produttive di beni materiali ma miranti a riprodurre le condizioni migliori per la forza lavoro (in pratica, le attività di cura e di benessere delle persone)» (qui). Una delle operazioni è quella di sostituire, tramite la robotica e comparti annessi, il lavoro vivo, in questo caso quello di cura e di assistenza, con le macchine, trasformandolo cioè in lavoro morto. Si tagliano i fondi per l’assistenza ai disabili utilizzandoli per finanziare ricerche e investimenti sulla robotica di aiuto personale che ha subito un grande sviluppo, ma che, in questo momento, non è approdata a risultati soddisfacenti per la tipologia della domanda, con il risultato che a rimetterci sono proprio i disabili. Si tratta di infatuazione tecnologica legata a forme di pensiero prodotte dall’attuale sistema economico. La sostituzione della mano d’opera con lavoro morto, quindi con la macchina, non è un male assoluto. Anzi, nel pensiero marxista sganciare la vita dalla dipendenza dal lavoro salariato è un obiettivo da perseguire. Ma, in questo momento, ci sono situazioni nelle quali la macchina può dare certi aiuti e non altri. Quindi lo stadio attuale della tecnologia aiuta coloro che hanno meno bisogno di aiuto esaurendo le risorse per un aiuto più diffuso.

Luca Pampaloni, a proposito del comportamento di alcuni amministratori della sanità nei confronti dei disabili nota che il sistema dominato dal profitto, il capitale, vuole ora «appropriarsi di tutto il settore del cosiddetto “lavoro riproduttivo” – cioè quelle attività non immediatamente produttive di beni materiali ma miranti a riprodurre le condizioni migliori per la forza lavoro (in pratica, le attività di cura e di benessere delle persone)» (qui). Una delle operazioni è quella di sostituire, tramite la robotica e comparti annessi, il lavoro vivo, in questo caso quello di cura e di assistenza, con le macchine, trasformandolo cioè in lavoro morto. Si tagliano i fondi per l’assistenza ai disabili utilizzandoli per finanziare ricerche e investimenti sulla robotica di aiuto personale che ha subito un grande sviluppo, ma che, in questo momento, non è approdata a risultati soddisfacenti per la tipologia della domanda, con il risultato che a rimetterci sono proprio i disabili. Si tratta di infatuazione tecnologica legata a forme di pensiero prodotte dall’attuale sistema economico. La sostituzione della mano d’opera con lavoro morto, quindi con la macchina, non è un male assoluto. Anzi, nel pensiero marxista sganciare la vita dalla dipendenza dal lavoro salariato è un obiettivo da perseguire. Ma, in questo momento, ci sono situazioni nelle quali la macchina può dare certi aiuti e non altri. Quindi lo stadio attuale della tecnologia aiuta coloro che hanno meno bisogno di aiuto esaurendo le risorse per un aiuto più diffuso.

Al tempo della pandemia

La paura è uno dei veicoli della tirannia. La paura ci ha fatto delegare il potere a un sovrano che incarna la cosa comune, lo Stato. La nostra delega ha creato dispositivi e istituzione di governance biopolitica. Adesso siamo di fronte a delle «tecnologie dell’amministrazione della vita e della premura» (Sadin p. 148). Lo spazio chiuso e personale della casa e le attività di cura e riproduzione che vi si svolgevano, sono esteriorizzate. La distinzione oikos (spazio domestico) e polis (spazio pubblico), perde senso. Il progetto è quello apparentemente felice di un’umanità accudita, coccolata e coadiuvata. Si tratta però di un’umanità teleguidata dalla macchina complessa. Non si tratta di semplice controllo, in gioco c’è una forma di influenza.

Da un vocabolario in espansione a quello contratto che supporta la macchina. Il rapporto ambiguo tra referente, significante e significato alla base della comunicazione umana che permette l’evocazione, il bisbiglio del senso, l’epifania auratica della parola; il canto, l’alone semantico, non piacciono alla macchina. La macchina è una macchina della verità. La macchina non capisce questo paragrafo. La macchina conta. La differenza è tra verità e efficacia. Parlare efficace è diverso dal dire il vero. Ma l’efficacia del discorso umano è cosa ben diversa dall’efficacia della macchina. L’efficacia del linguaggio è tutta interna alla relazione sia dal punto di vista del senso, sia da quello delle relazioni di potere. L’efficacia della macchina è asservita allo scopo. L’algoritmo di scopo è l’algoritmo che persegue il profitto. Tutte le articolazione portano in ultima istanza allo scopo primario.

Al tempo della pandemia tutto si manifesta a distanza, ma anche al suo contrario: la rete elimina le distanze. Al tempo della pandemia le scuole erano chiuse. L’amore al tempo della pandemia, non era facile. La scuola, lo studio lo stesso. I malati di progressismo esultarono di fronte a questa occasione unica di sperimentare l’elearning di massa. Una situazione nella quale si poteva mettere a frutto gli strumenti messi a disposizione dalla tecnoscienza moderna. Ma quegli strumenti non erano equamente distribuiti. Alcuni studenti si collegarono, molti sparirono. Al tempo della società della sorveglianza, in media, più della metà degli studenti di ogni classe scomparve. Non c’era “banda” per tutti. Abituati a essere tenuti sotto controllo; abituati a studiare in vista di un compito o di una verifica; abituati a partecipare soltanto in seguito alla sollecitazione minatoria, metà degli studenti fece forca. La sorveglianza reale e quella verbale non erano la stessa cosa. La pandemia giustificava comportamenti assenteisti. Una società che si costruisce come la società della sorveglianza ispira i comportamenti più abietti appena ci si trova in un angolo buio, nel campo non coperto dallo sguardo inquirente. Anche l’insegnamento è relazione. È relazione orizzontale, i compagni/compagne, e verticale, docenti/discenti. È relazione e costruzione di un modo della relazione. È anche peer learning che, al di là dell’inglesismo tassonomico, era addirittura una prerogativa della scuola di Barbiana. Una forma di insegnamento/apprendimento che presuppone la conoscenza degli altri, che si fa con gli altri. Che si svolge in maniera ogni volta diversa a partire da chi partecipa. Non c’è un sapere contenuto nel cloud che si riversa a “pioggia” sugli “utenti”. La macchina può sostituire soltanto comportamenti e produzioni che possono essere disumani. Sembra una tautologia, invece è una cartina di tornasole.

Il restate a casa al tempo della pandemia, significa oggi realizzare l’enclosure patriarcale della famiglia mono nucleale. Viverne la pesantezza all’ennesima potenza. Scoprire i dialoghi mancati e mancanti. I prodigi della tecnoscienza messi adesso a una vera prova sul campo, rivelano la loro inconsistenza. Gli umani, accuditi e coccolati dalle macchine, non possono prendersela comoda. Il socius è profilato e parcellizzato. Al tempo della pandemia si fa evidente come sia effimero il contesto che la macchina propone.

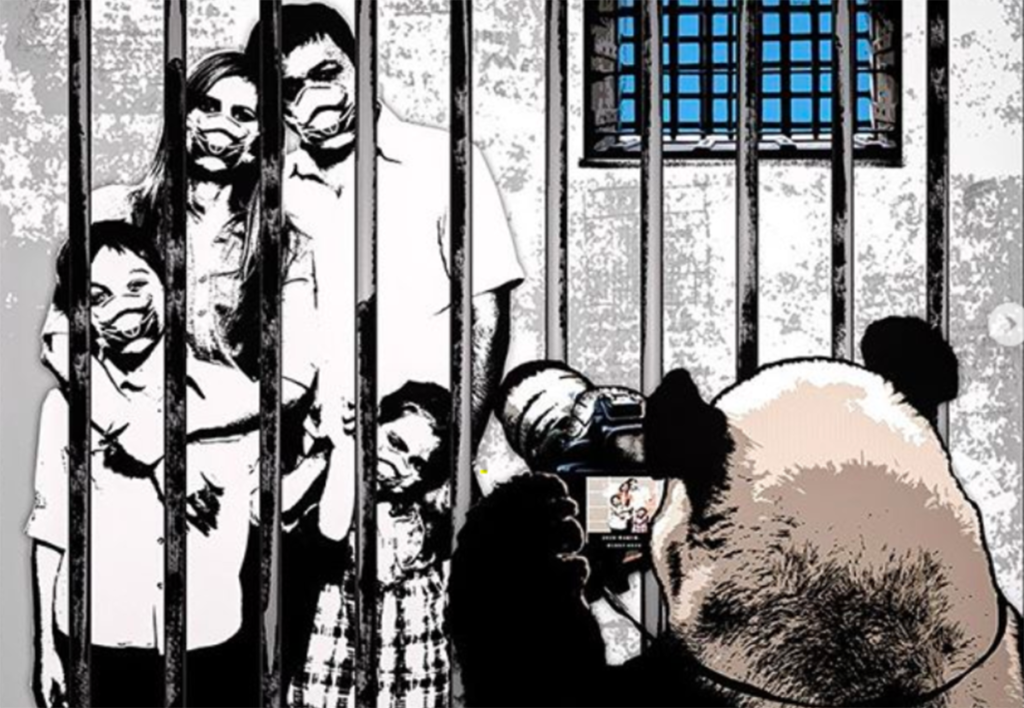

Le nuove tecnologie potrebbero essere d’aiuto per combattere la diffusione del virus che ha provocato questa pandemia. Si è parlato di monitoraggio dei contagiati, ma anche di tutta la popolazione per costringerla a tenere i comportamenti che i tecnici si auspicano vengano tenuti. Cosa quest’ultima teoricamente possibile, ma praticamente poco praticabile e gestibile da un super visore umano. Si dovrebbe lasciar fare alla macchina, a dei dispositivi automatici che, per esempio, segnalino gli assembramenti o gli spostamenti inopportuni di coloro che dovevano stare in quarantena. Ma potrebbero fare di più, calcolare le probabilità che un individuo possa essere contagiato e prendere nei suoi confronti le misure adeguate. Avevamo già parlato dell’uso delle profilazioni da parte delle assicurazioni e del rischio di discriminazioni che la cosa comportava, ma, dentro la pandemia, il rischio è che non venga permesso a Tizio o a Caio di accedere a un luogo o di poter prendere un mezzo pubblico o accedere a un pubblico esercizio, insomma, si tratterebbe di discriminazioni pesanti, di forme di apartheid sanitario. E quali potrebbero essere i criteri con i quali ha lavorato l’algoritmo e con i quali si è costruito dei pattern efficaci? Il fatto di guadagnare una cifra al di sotto di una certa soglia differenziale, vivere in una famiglia numerosa, vivere in una periferia urbana o provenire da una data regione. Si riaprono di nuovo le possibilità di una discriminazione sociale che punisce i ceti e le minoranze più deboli. Si apre la possibilità di un’eugenetica di classe, dopo quella indirettamente in atto verso i malati più fragili ai quali – data la scarsità di mezzi terapeutici riscontrabile in alcune circostanze – vengono preferiti coloro che hanno una maggiore probabilità di sopravvivere.

Tutto questo è stato fatto in Cina al tempo della pandemia. Una App costituisce il lasciapassare di ognuno. Gli algoritmi di profilazione ti assegnano un codice, verde per chi è sano, giallo e rosso a determinare il tipo di restrizioni assegnate. In Cina lo fa lo stato, nel mondo occidentale tutta questa potenza è in mano a pochi privati. (Vedi anche più avanti – IX parte, i punti sesamo)

Al tempo della pandemia, non sappiamo quanto sia questo tempo. Quanto le misure di contenimento dovranno durare e se ci sarà un termine dell’emergenza. Se i tempi si allungassero bisognerà cambiare certi stili di vita. Si potrebbe tentare di ripristinare delle forme di socializzazione più sicure usando mezzi più sofisticati «per identificare chi sia a rischio di malattia e chi no, e discriminando legalmente chi lo è». Si potrebbero dotare le persone di un passaporto comportamentale nel quale sistemi automatici segnalerebbero se foste stati vicini a persone infette o a punti caldi della malattia con il rischio di discriminare le persone che vivono in zone più esposte alle malattie. «I gig-worker, quelli che fanno lavoretti e sono molto in giro, come autisti, idraulici, istruttori di yoga freelance, vedranno il loro lavoro diventare ancora più precario. Gli immigrati, i rifugiati, i clandestini e gli ex detenuti dovranno affrontare l’ennesimo ostacolo all’ingresso nella società», dice Lichfield. Come dopo l’undici di settembre si è chiesto alle persone di rinunciare ad alcune libertà personali nel nome della sicurezza, così adesso l’apparato di controllo della società della sorveglianza, trova un’altra istanza di giustificazione. Il meccanismo mentale è lo stesso. Diffido dell’altro, del mio vicino. È il trionfo delle singolarità di consumo. È sconveniente se non pericoloso darsi una mano. Si costruiscono piani di esclusione e di discriminazione in nome di un benessere collettivo che chiamano sicurezza. Dove il decoro non è un criterio estetico, è semplicemente la messa in forma della normalità auspicata dal sistema. Alimento perfetto per una filosofia della vita controllata algoritmicamente.

Continua…

Èric Sadin, Critica della ragione artificiale – Una difesa dell’umanità, Luiss, Roma 2019

Qui la I

Qui la II

Qui la III

Qui la IV

Qui la V

*Gilberto Pierazzuoli

Gilberto Pierazzuoli

Ultimi post di Gilberto Pierazzuoli (vedi tutti)

- Le AI e il gioco del Ripiglino - 18 Gennaio 2024

- I consigli di lettura di Gilberto Pierazzuoli - 24 Dicembre 2023

- Le AI e la voce - 12 Dicembre 2023